Mit der zunehmenden Integration von Robotern in unseren Alltag stellen sich wichtige ethische Fragen. Dieser Artikel untersucht die wichtigsten ethischen Herausforderungen der modernen Robotik und diskutiert mögliche Lösungsansätze für eine verantwortungsvolle Entwicklung.

Die ethischen Dimensionen der Robotik

Die Robotik berührt ein breites Spektrum ethischer Dimensionen: von Fragen der Autonomie und Verantwortung über Datenschutz und Privatsphäre bis hin zu sozialen Auswirkungen und der Mensch-Roboter-Interaktion. Mit zunehmender Intelligenz und Autonomie von Robotersystemen werden diese ethischen Fragen immer drängender.

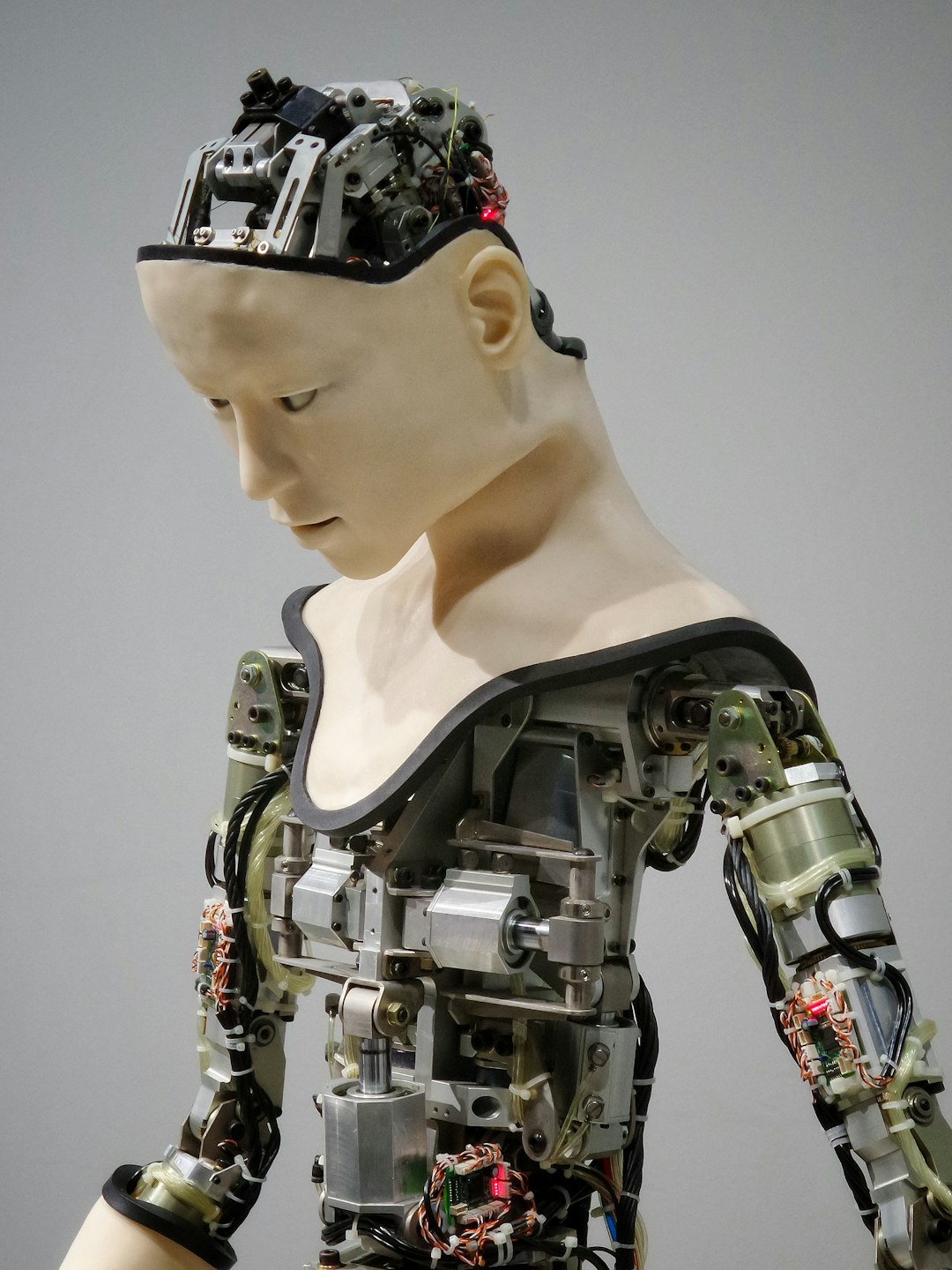

Anders als bei vielen anderen Technologien haben Roboter das Potenzial, aktiv in unsere physische Welt einzugreifen und Entscheidungen zu treffen, die unmittelbare Auswirkungen auf Menschen haben können. Dies verleiht der Roboterethik eine besondere Dringlichkeit und Komplexität.

Autonomie und Verantwortung: Wer haftet für die Entscheidungen von Robotern?

Eine der grundlegendsten ethischen Fragen betrifft die Verantwortung für Handlungen autonomer Robotersysteme. Wenn ein selbstfahrendes Auto einen Unfall verursacht, wer trägt die Verantwortung? Der Hersteller, der Programmierer, der Besitzer oder das System selbst?

Diese Frage wird besonders komplex bei Systemen, die maschinelles Lernen einsetzen und deren Entscheidungsprozesse nicht vollständig nachvollziehbar sind. Das Problem der "Black Box" in KI-Systemen erschwert die Zuordnung von Verantwortung erheblich.

"Die Frage der Verantwortung ist nicht nur eine rechtliche, sondern auch eine zutiefst ethische Frage. Sie berührt unser Verständnis von Handlungsfähigkeit, Schuld und Gerechtigkeit in einer Welt, in der Maschinen zunehmend autonome Entscheidungen treffen." - Prof. Dr. Martin Fischer, Ethiker

Ein vielversprechender Ansatz ist das Konzept der "erklärbare KI" (Explainable AI), das darauf abzielt, die Entscheidungsprozesse von KI-Systemen transparenter und nachvollziehbarer zu machen. Gleichzeitig entwickeln sich rechtliche Rahmenwerke, die eine abgestufte Verantwortung verschiedener Akteure vorsehen.

Privatsphäre und Datenschutz: Die allgegenwärtigen digitalen Augen

Moderne Roboter sind mit zahlreichen Sensoren ausgestattet - Kameras, Mikrofone, Bewegungssensoren - die kontinuierlich Daten über ihre Umgebung und die Menschen darin sammeln. Dies wirft ernsthafte Fragen zum Schutz der Privatsphäre auf.

Besonders sensibel ist dies bei Haushaltsrobotern oder Pflegerobotern, die in den intimsten Bereichen unseres Lebens präsent sind. Welche Daten werden erfasst? Wo werden sie gespeichert? Wer hat Zugriff darauf? Und wie werden sie geschützt?

Die Europäische Datenschutz-Grundverordnung (DSGVO) bietet hier bereits einen starken regulatorischen Rahmen, der Prinzipien wie Datensparsamkeit, Zweckbindung und informierte Einwilligung betont. Technische Ansätze wie Privacy by Design, lokale Datenverarbeitung oder Federated Learning können dazu beitragen, Datenschutzrisiken zu minimieren.

Soziale und wirtschaftliche Auswirkungen: Die Arbeitswelt im Wandel

Die zunehmende Automatisierung durch Roboter verändert die Arbeitswelt grundlegend. Während sie einerseits von gefährlichen, monotonen oder belastenden Aufgaben befreien kann, droht sie andererseits, bestimmte Berufsgruppen obsolet zu machen und soziale Ungleichheit zu verschärfen.

Eine ethisch verantwortungsvolle Robotik muss diese sozialen und wirtschaftlichen Auswirkungen berücksichtigen. Dies bedeutet, nicht nur zu fragen, was technisch möglich ist, sondern auch, welche Auswirkungen die Technologie auf die Gesellschaft haben wird.

Mögliche Ansätze umfassen Umschulungs- und Weiterbildungsprogramme für betroffene Arbeitnehmer, neue Modelle sozialer Sicherung wie ein bedingungsloses Grundeinkommen oder Robotersteuern, sowie eine stärkere Beteiligung verschiedener gesellschaftlicher Gruppen an der Gestaltung neuer Technologien.

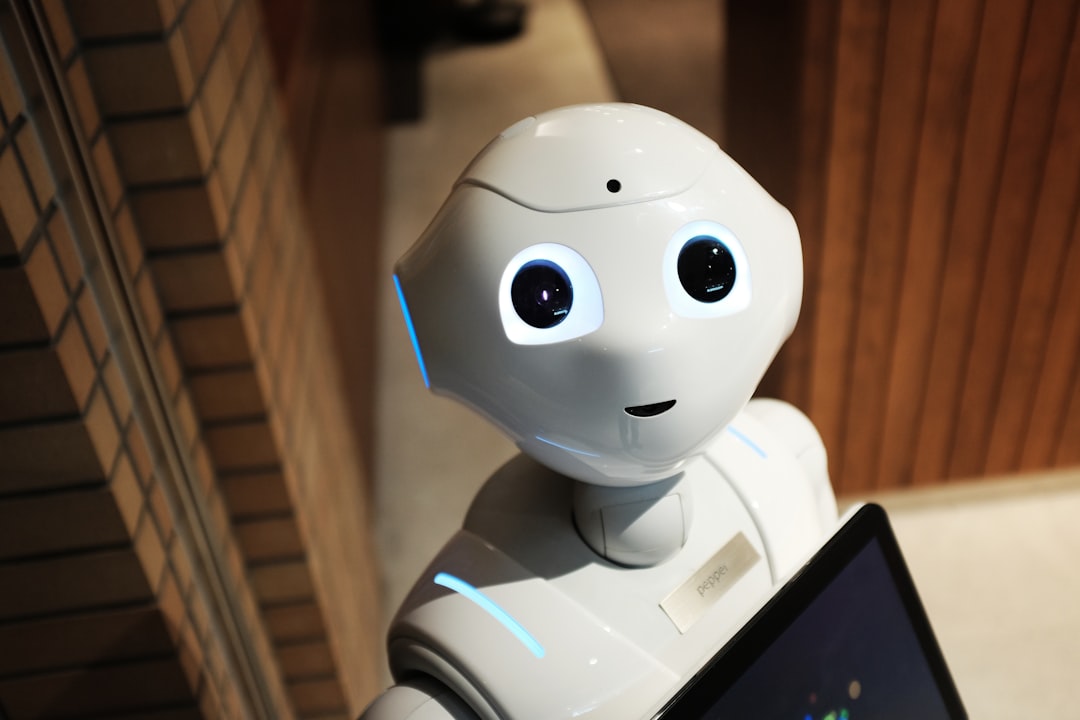

Mensch-Roboter-Interaktion: Emotionale Bindung und Täuschung

Soziale Roboter sind darauf ausgelegt, menschenähnlich zu interagieren und emotionale Reaktionen hervorzurufen. Dies kann wertvolle therapeutische Anwendungen haben, etwa bei der Betreuung von Menschen mit Demenz oder bei der Unterstützung von Kindern mit Autismus.

Gleichzeitig wirft es ethische Fragen auf: Ist es moralisch vertretbar, wenn Menschen emotionale Bindungen zu Maschinen entwickeln, die diese Emotionen nicht erwidern können? Handelt es sich um eine Form der Täuschung, wenn Roboter menschenähnliches Verhalten simulieren?

Diese Fragen sind besonders relevant bei vulnerablen Gruppen wie Kindern oder älteren Menschen, die möglicherweise nicht vollständig verstehen, dass die scheinbaren Emotionen des Roboters programmiert sind.

Ein ethischer Ansatz könnte darin bestehen, Transparenz über die Natur des Roboters zu gewährleisten und soziale Roboter als Ergänzung, nicht als Ersatz für menschliche Interaktion zu konzipieren.

Militärische Robotik: Die Automation des Krieges

Ein besonders kontroverser Bereich ist die militärische Robotik, insbesondere die Entwicklung letaler autonomer Waffensysteme (LAWS), die ohne menschliches Eingreifen Ziele identifizieren und angreifen können.

Die ethischen Bedenken sind vielfältig: Sollten Maschinen jemals die Entscheidung über Leben und Tod treffen dürfen? Wie wirkt sich die Distanzierung vom Kampfgeschehen auf die Hemmschwelle zur Kriegsführung aus? Und wer trägt die Verantwortung für mögliche Kriegsverbrechen durch autonome Systeme?

Zahlreiche Organisationen, Wissenschaftler und auch Technologieunternehmen haben sich für ein präventives Verbot letaler autonomer Waffen ausgesprochen. Die UN-Waffenkonvention diskutiert seit Jahren über mögliche Regulierungen, bisher ohne verbindliches Ergebnis.

Von ethischen Prinzipien zu konkreten Handlungen

Die Überbrückung der Kluft zwischen abstrakten ethischen Prinzipien und konkreten Design- und Implementierungsentscheidungen ist eine zentrale Herausforderung. Hierfür haben sich verschiedene Ansätze entwickelt:

Ethische Richtlinien und Kodizes

Zahlreiche Organisationen haben ethische Richtlinien für die Robotik entwickelt, darunter die IEEE mit ihren "Ethically Aligned Design"-Prinzipien oder die Europäische Kommission mit ihren "Ethics Guidelines for Trustworthy AI". Diese bieten Orientierung, sind aber oft nicht rechtsverbindlich.

Value Sensitive Design

Dieser Ansatz integriert ethische Überlegungen direkt in den Designprozess von Technologien. Werte wie Privatsphäre, Autonomie oder Fairness werden von Beginn an als Designziele betrachtet, nicht als nachträgliche Überlegungen.

Ethik-Ausschüsse und Impact Assessments

Ähnlich wie bei klinischen Studien können Ethik-Ausschüsse Robotik-Projekte begutachten und ethische Bedenken identifizieren. Algorithmische Impact Assessments können systematisch die potenziellen Auswirkungen neuer Systeme evaluieren.

Partizipative Gestaltung

Die Einbeziehung verschiedener Stakeholder - einschließlich potenzieller Nutzer, betroffener Gemeinschaften und ethischer Experten - in den Entwicklungsprozess kann dazu beitragen, dass unterschiedliche Perspektiven und Werte berücksichtigt werden.

Der Weg zu einer ethisch verantwortungsvollen Robotik

Eine ethisch verantwortungsvolle Entwicklung der Robotik erfordert ein Zusammenspiel verschiedener Akteure: Forscher, Entwickler, Unternehmen, Regulierungsbehörden, zivilgesellschaftliche Organisationen und die Öffentlichkeit.

Es geht nicht darum, Innovation zu bremsen, sondern sie in eine Richtung zu lenken, die menschliche Werte respektiert und fördert. Die größte Herausforderung besteht darin, eine Balance zu finden zwischen dem technologischen Fortschritt und dem Schutz fundamentaler ethischer Prinzipien.

Mit einem reflektierten, inklusiven und vorausschauenden Ansatz können wir eine Zukunft gestalten, in der Robotik ihr volles Potenzial entfaltet, menschliches Wohlbefinden zu verbessern - ohne dabei unsere ethischen Grundwerte zu kompromittieren.